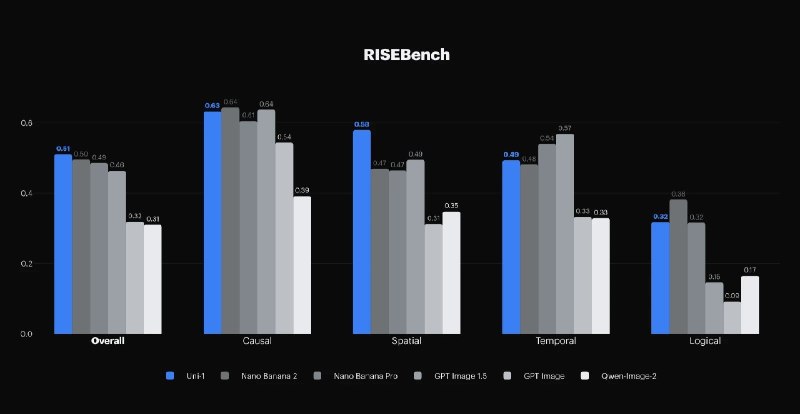

✴️ Luma AI представила мультимодальную модель Uni-1

Luma AI выпустили Uni-1 — модель, объединяющую генерацию и понимание визуального контента. Базируется на архитектуре авторегрессионного трансформера (decoder-only) и обрабатывает текст с изображениями в виде единой перемешанной последовательности.

— Применяет внутреннюю цепочку рассуждений перед и во время отрисовки: разбивает промпты на шаги, учитывает пространственные и логические ограничения.

— Генерирует согласованные кадры с сохранением таймлайна и прогрессии событий (например, процесс старения персонажа от ребенка до старика в одной локации).

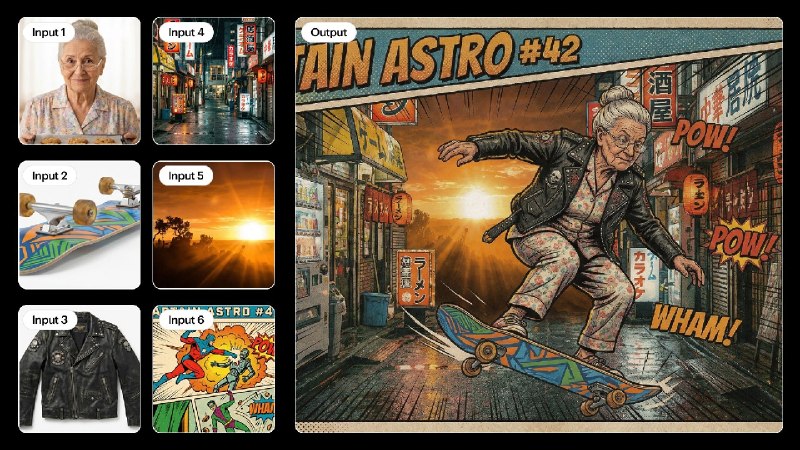

— Поддерживает управление через скетчи, визуальные инструкции и многошаговые корректировки. Удерживает идентичность лиц и композицию при объединении до 8 картинок-референсов.

— Адаптирует исходники под 76 художественных стилей (от манги до кубизма) без потери структуры оригинала.

— В будущем архитектуру расширят для генерации видео, создания голосовых агентов и интерактивной симуляции миров.

API станет доступно в ближайшее время.

Попробовать бесплатно можно здесь: клик.

Добавить комментарий