✴️ Как делают «Claude-подобные» локальные модели и что такое abliterated

Сейчас вокруг Qwen3.5 появился новый класс моделей — это не обычные файнтюны, а комбинация дистилляции от топовых LLM (Claude, Gemini) и экспериментов с удалением safety.

🟢 Как работает дистилляция (Claude → Qwen)

Берут сильную модель (например Claude Opus 4.6) и заставляют её решать тысячи задач с подробными рассуждениями. Затем эти ответы используют как обучающие данные для Qwen.

То есть модель учится не просто «давать ответ», а повторять стиль мышления другой модели.

Что переносится:

🟡 структура рассуждений

🟡 логика решения задач

🟡 поведение в сложных сценариях

Пример модели:

Qwen3.5-27B Claude distilled

🟢 Что это даёт на практике

Такие модели:

🟡 лучше держат длинные цепочки reasoning

🟡 стабильнее работают в коде и аналитике

🟡 умеют вести многошаговые задачи как агент

Но важно:

🟡 это не полный уровень Claude

🟡 иногда это «имитация мышления», а не настоящее понимание

🟢 Есть не только Claude — уже есть дистиллы от Gemini

У того же Jackrong появляются версии, обученные на Gemini 3.1.

Разница ощущается:

🟡 Claude-дистиллы → более аккуратные и «вдумчивые»

🟡 Gemini-дистиллы → быстрее, но иногда менее глубокие

По сути, можно выбирать стиль мышления модели.

🟢 Что такое abliterated и в чём прикол

Модели вроде

Qwen3.5 abliterated

— это уже другой подход.

Здесь ничего не обучают заново. Вместо этого:

🟡 находят механизмы, отвечающие за отказы и ограничения

🟡 и удаляют их напрямую из модели

То есть это буквально модель без встроенных фильтров.

🟢 Что даёт abliterated

Плюсы:

🟡 почти нет отказов

🟡 меньше «осторожных» ответов

🟡 больше свободы в сложных темах

Минусы:

🟡 нет safety вообще

🟡 ответы могут быть рискованными

🟡 поведение менее предсказуемо

Авторы сами говорят — это эксперимент, не для продакшена.

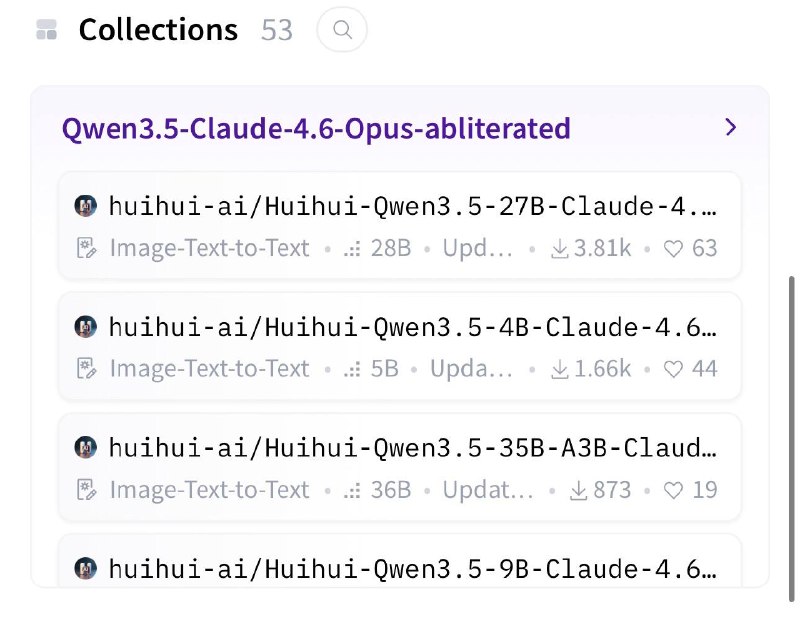

🤗 Коллекции моделей на Hugging Face:

🟡 все abliterated-модели от huihui →

Qwen3.5 abliterated collection

🟡 семейство дистиллов Jackrong →

модели Jackrong на Hugging Face

Добавить комментарий