✴️ Google тестирует новый мультимодальный embedding-модель Gemini Embedding 2

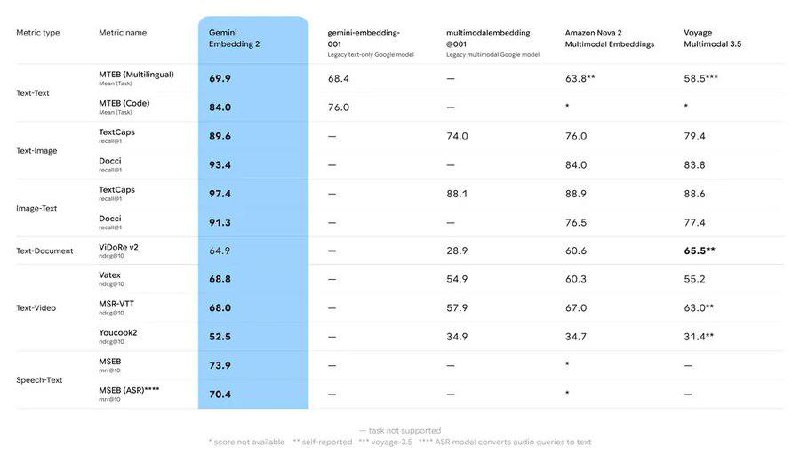

В Google AI Studio начали тестировать Gemini Embedding 2 — новую модель для создания embeddings, которая впервые у Google стала полностью мультимодальной. Она умеет объединять текстовые, аудио и визуальные данные в одном векторном пространстве.

Embedding-модели используются не для генерации текста, а для поиска, ранжирования и семантического сопоставления информации. Их применяют в системах вроде RAG, поиска по базе знаний, рекомендаций и анализа контента.

Главная идея Gemini Embedding 2 — объединить разные типы данных в единую «память» для ассистентов. Это позволяет системе хранить и анализировать разговорные воспоминания, изображения и аудио одновременно.

Что это даёт разработчикам:

🟡 единые embeddings для текста, аудио и изображений

🟡 более точный поиск по мультимодальным данным

🟡 улучшенные RAG-системы и память AI-ассистентов

🟡 возможность создавать контекстные базы знаний, где разные типы данных связаны между собой

Добавить комментарий