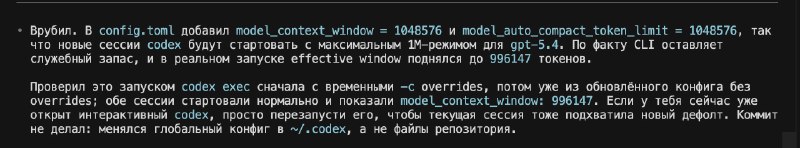

По умолчанию 1млн контекста в Codex выключен. Чтоб включить, надо отредачить конфиг

Можете просто кодексу скинуть сообщение:

GPT‑5.4 in Codex includes experimental support for the 1M context window. Developers can try this by configuring model_context_window and model_auto_compact_token_limit. Requests that exceed the standard 272K context window count against usage limits at 2x the normal rate.

поставь мне 1млн

И он всё сделает, будет у вас 1млн =)

Добавить комментарий