Тут Китайчат обвинили в knowledge distillation. 💳

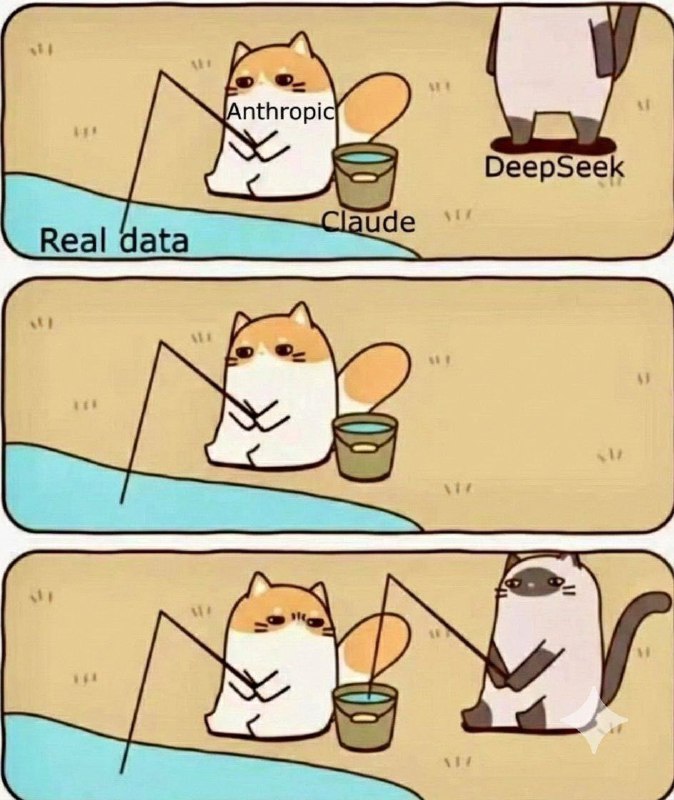

Мол топ3 модели абьюзят антропик по апи и юзают их генерации для дотюна моделей. По этому поводу у нас #meme. 👍

Пару слов от 📦. Работает ли? Да работает. Вспомним старый добрый alpaca в 2023 году, как способ отдистиллить small LM Llama модели. Можно брать их методологию и репо для воспроизведения на up to date моделях. Далее, конечно, по пользовательскому соглашению это запрещено. Читайте офферту 🚬.

Но помните, что это юзают для SFT, те для тюна моделей. А это накладывает требования на базовую модель, те претрен должен быть сильным и хорошим фундаментом. Починить его даже sft не поможет, даже с дистиллятом поведения GPT. Поэтому снимаем шляпу перед Китаем за базу. А если у вас плохая база, вам как с домом, придётся разобрать до фундамента, модель, чтобы её починить, поэтому не все так просто. 🥴

И китайцы всеравно молодцы. 😎

Добавить комментарий