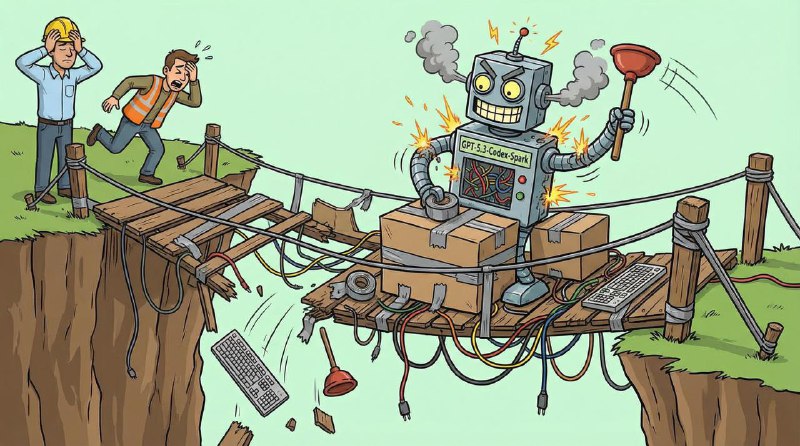

«Быстро. Дёшево. Бесполезно» – немного про опыт использования GPT-5.3-Codex-Spark в задачах разработки.

Есть такой прекрасный сервис – Cerebras. Упоминал их в этом материале.

Компания делает чипы, оптимизированные под работу с LLM. Создают их таким образом, что некоторые (не самые большие) модели вмещаются целиком на один чип и, благодаря этому, выдают впечатляющую скорость инференса.

В результате партнёрской сделки между OpenAI и Cerebras, про которую стало известно 14 января, появилась та самая GPT-5.3-Codex-Spark.

Фактически, это урезанная GPT-5.3-Codex. Урезанная ровно настолько, чтобы поместиться на чип Cerebras и получить преимущество по скорости.

Скорость действительно поражает. Но на этом всё.

Чтобы с данной моделью получить приемлемый результат, я вижу две стратегии:

1. Микро-правки, где после каждого небольшого шага LLM, пользователь проводит детальное ревью и направляет AI-агента в новую микро-задачу.

2. Отправить модель по строгому максимально-детерменированному пайплайну, в котором Spark просто не сможет себе позволить вольности.

Первая стратегия – это то, от чего мы начали уходить ещё год назад. Когда появился Claude Code и AI-coding-агентам стали давать больше свободы (хорошо, когда с детерменированными проверками за счёт хуков).

А вторая… Если честно, в таком пайплайне лучше подойдёт более сообразительная GPT-5.3-Codex. Она, конечно, чуть медленнее, но разница не так велика, как со вдумчивой GPT-5.2 High, например. А GPT-5.3-Codex сможет обеспечить куда меньшее количество правок на ровном месте.

Для первого опыта в рамках партнёрства с Cerebras, результат – нормальный. На мой пайплайн разработки не повлияет (буду продолжать использовать другие модели), но следующая версия Spark, возможно, станет более понятной и предсказуемой. И сохранит при этом впечатляющую скорость.

Добавить комментарий