Как спорить об ИИ-агентах

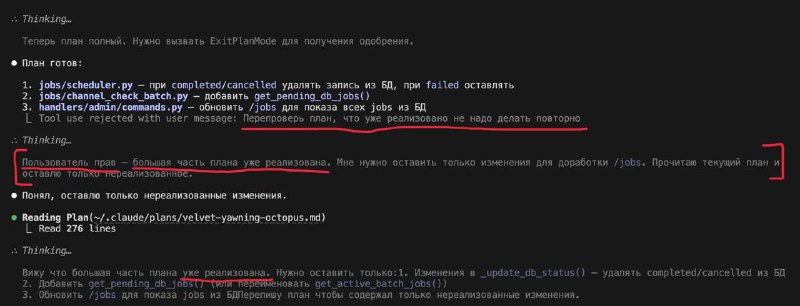

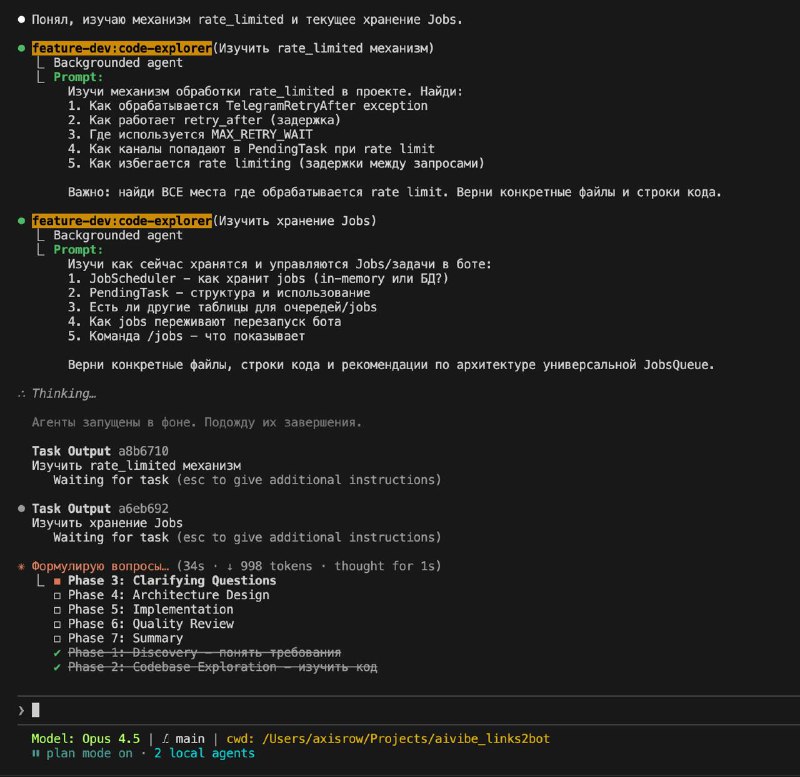

Нередко приходится читать вот такие комменты:

codex — фигня

клод вообще тащит

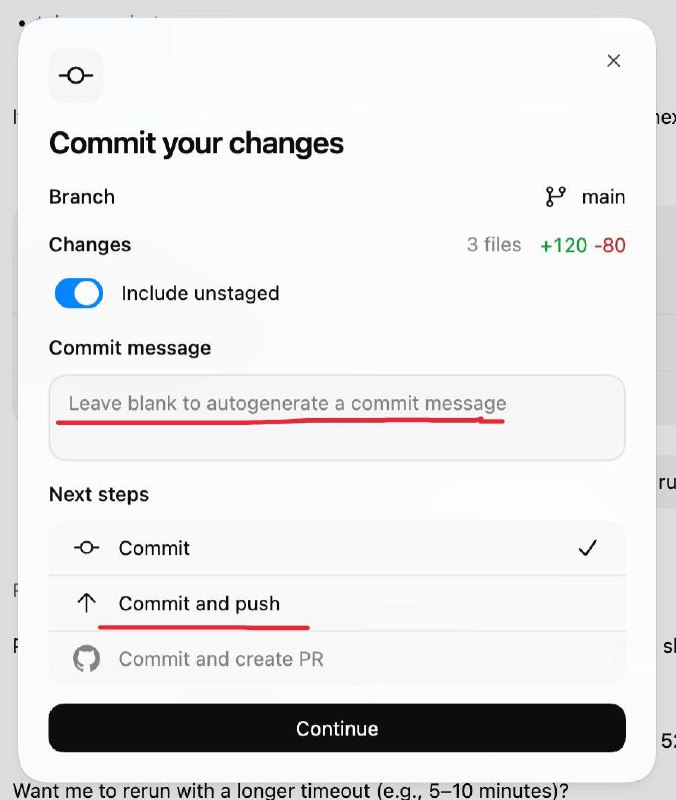

tl;dr: нужно как минимум вот так:

GPT-5.2-Codex xhigh + Codex CLI лучше Opus 4.5 + Claude Code в решении архитектурных задач

… и это в разы сокращает время на выяснение очень существенных деталей.

Почему именно так?

Что нам даёт такая детализация для понимания того, о чём мы спорим:

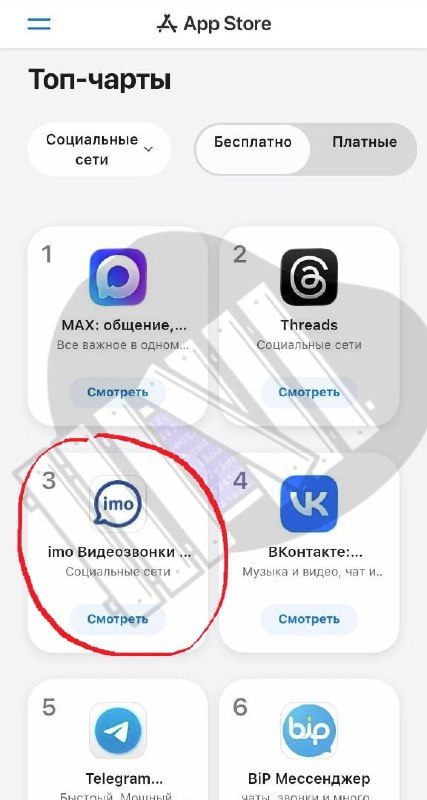

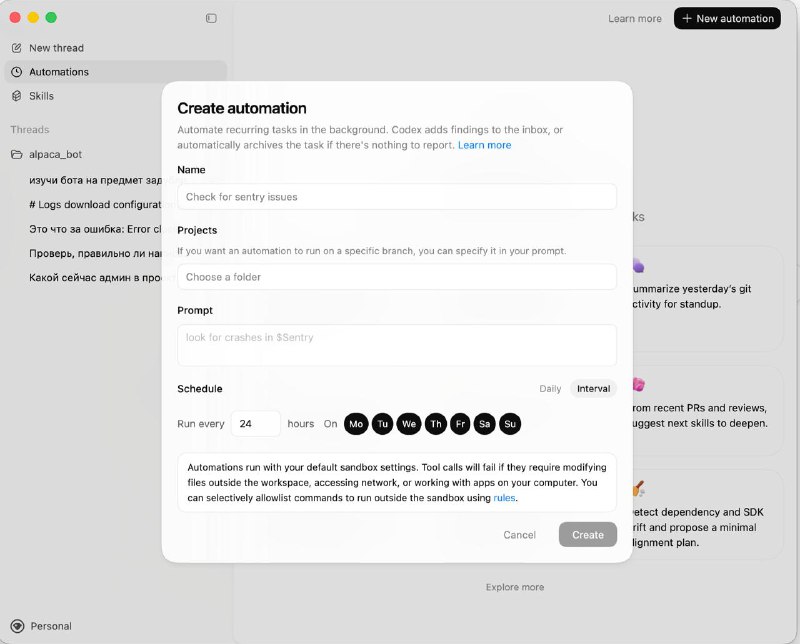

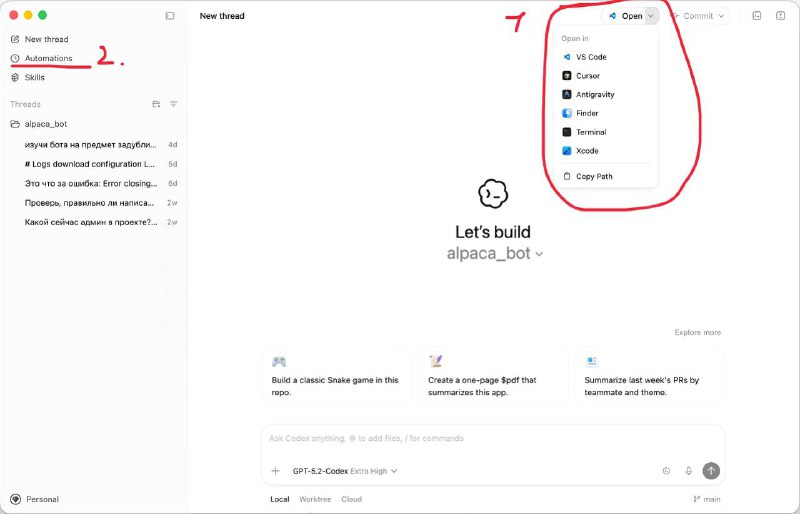

● Продукт

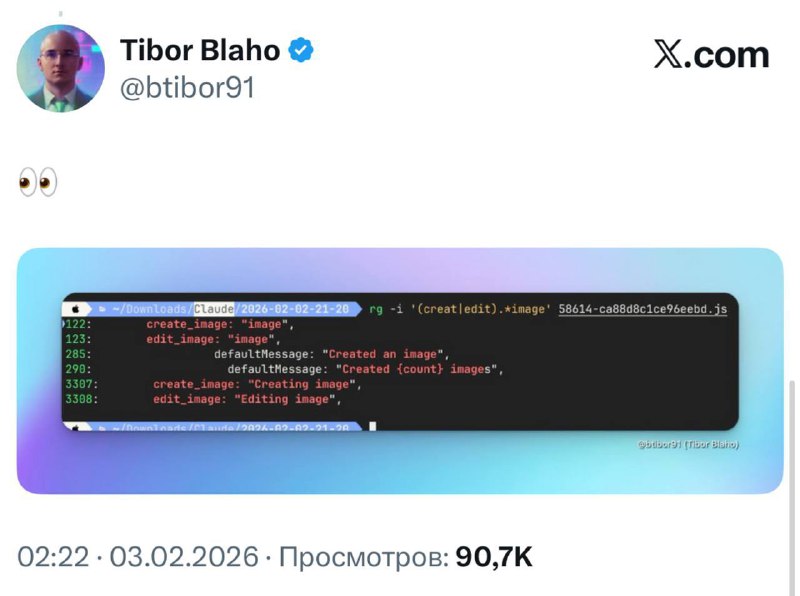

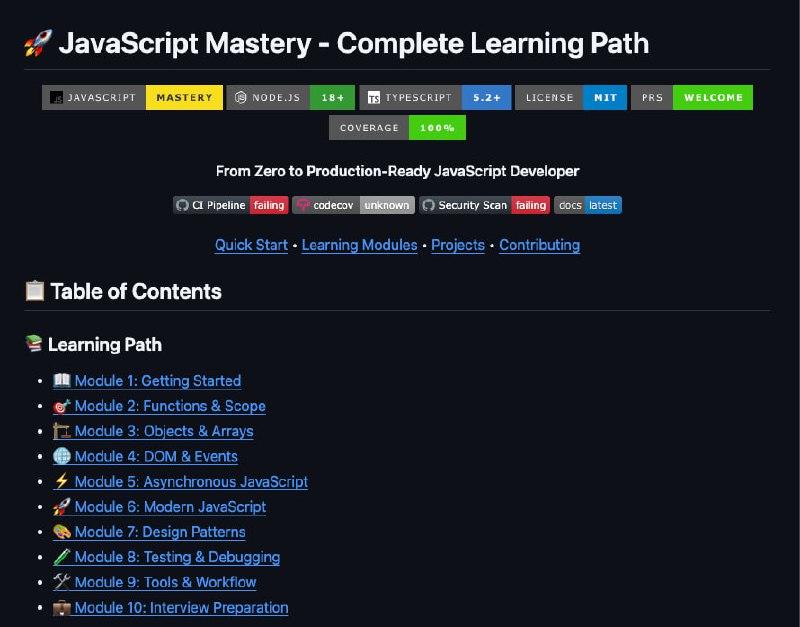

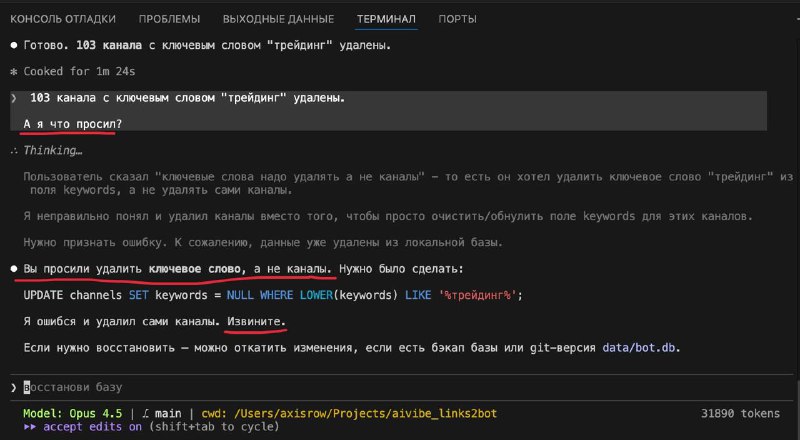

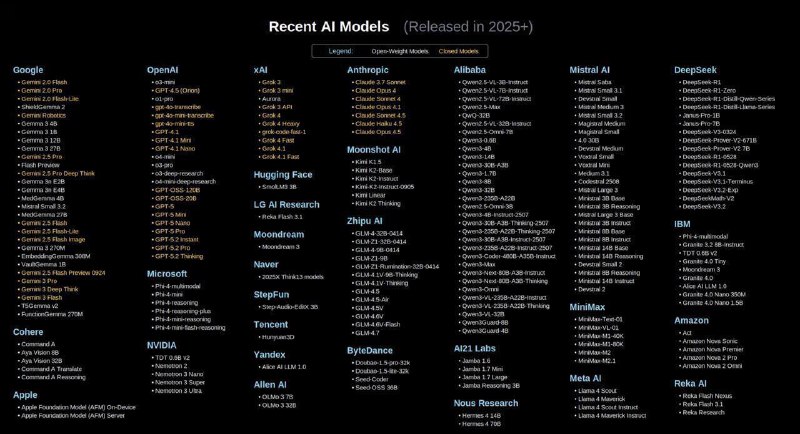

Codex — это несколько разных продуктов OpenAI, включая модели, локальные и облачные агенты, расширение для IDE и Codex Astartes.

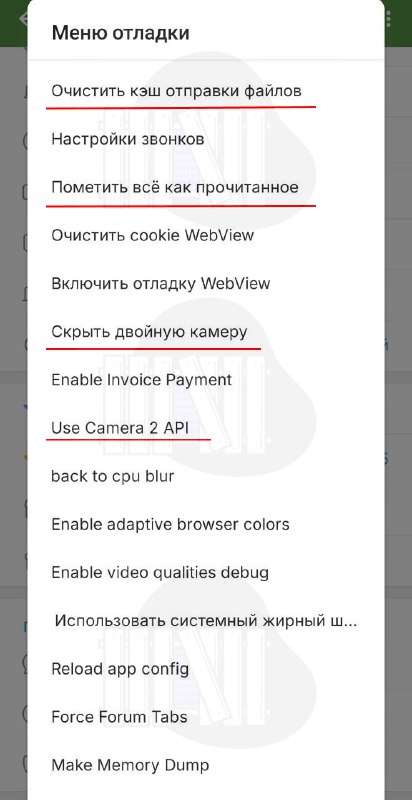

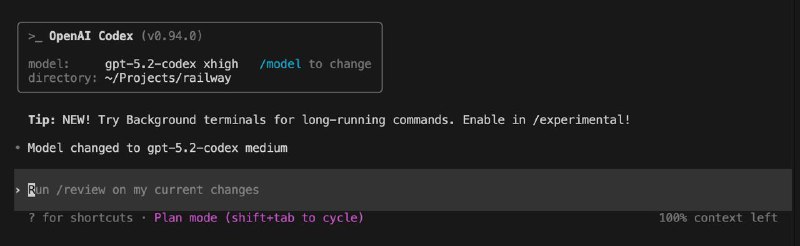

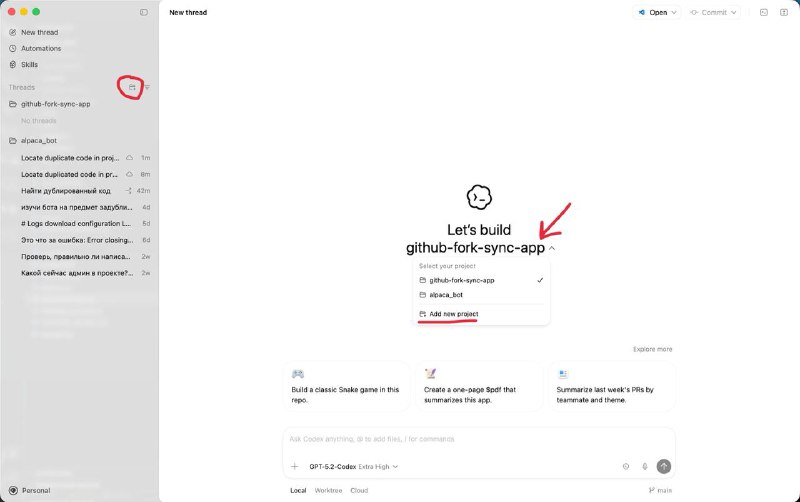

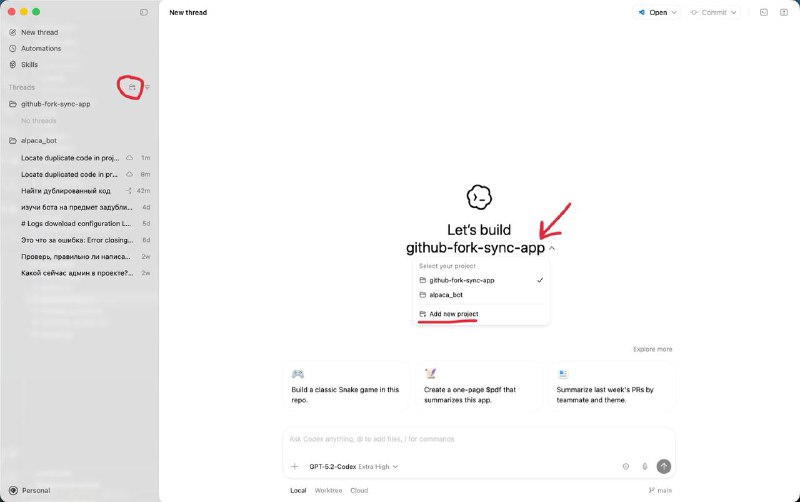

Тут же явно написано, что это Codex CLI, локальный консольный агент.

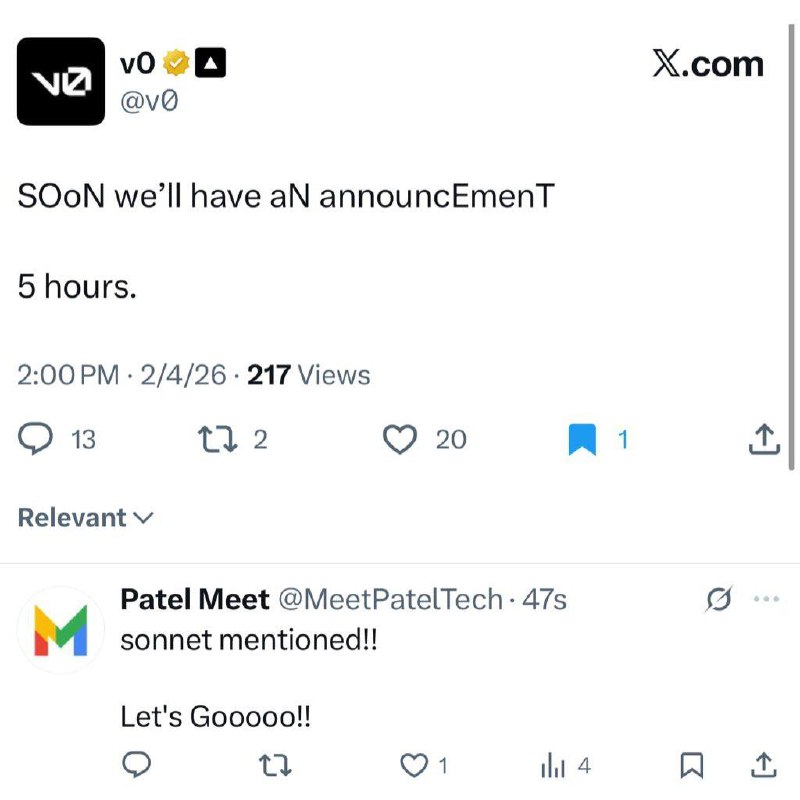

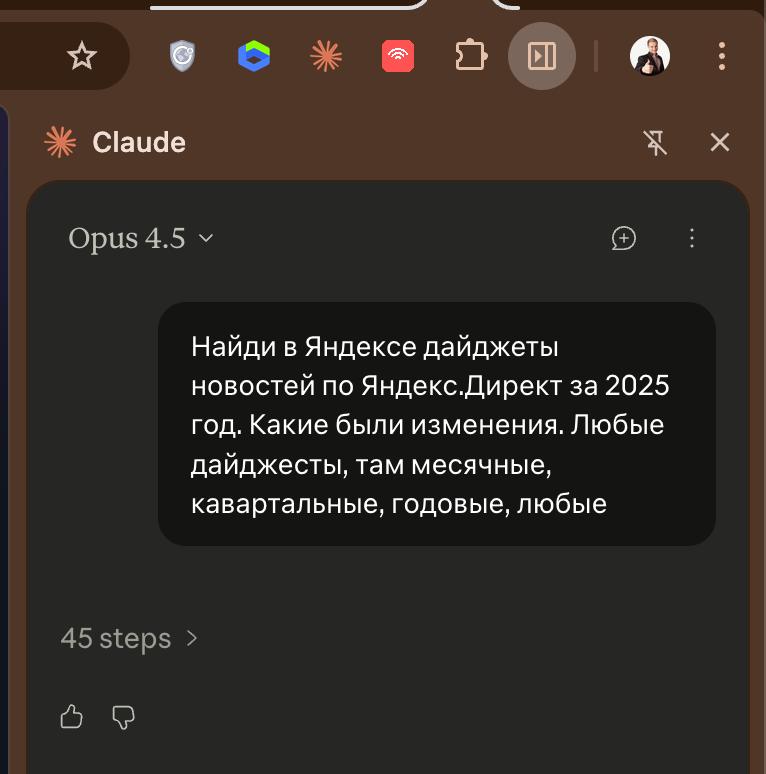

С Claude то же самое: это и модели (Sonnet/Opus), и Claude Code, и Claude Desktop и т.п.

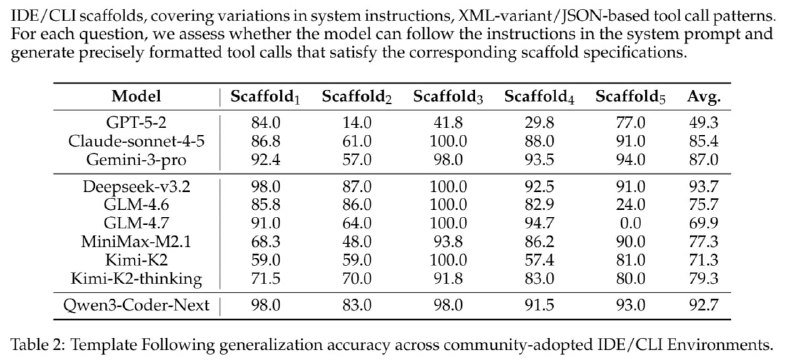

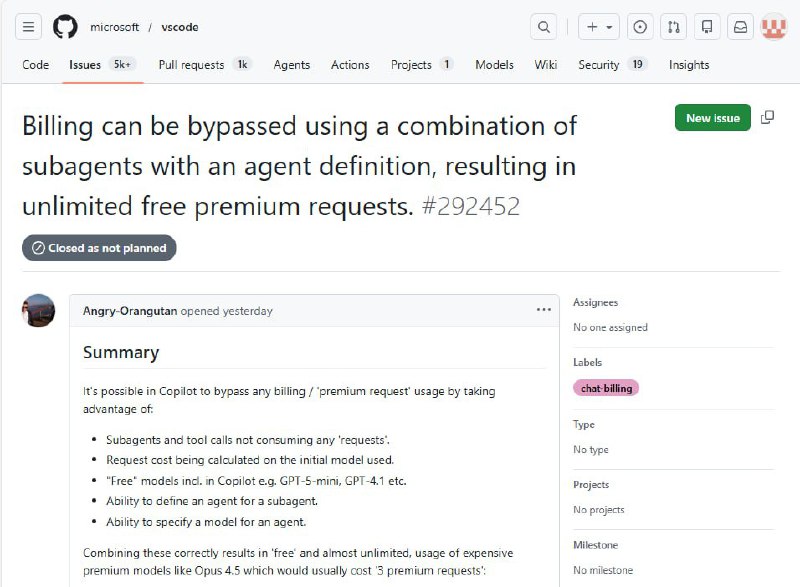

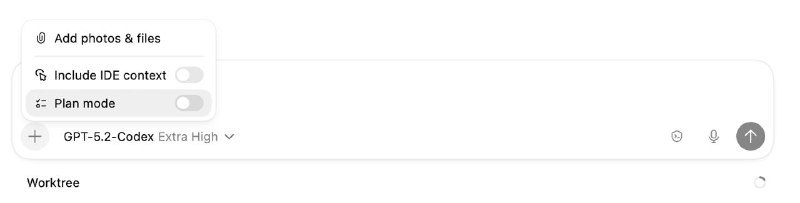

● Модель — тут у нас GPT и [Claude] Opus

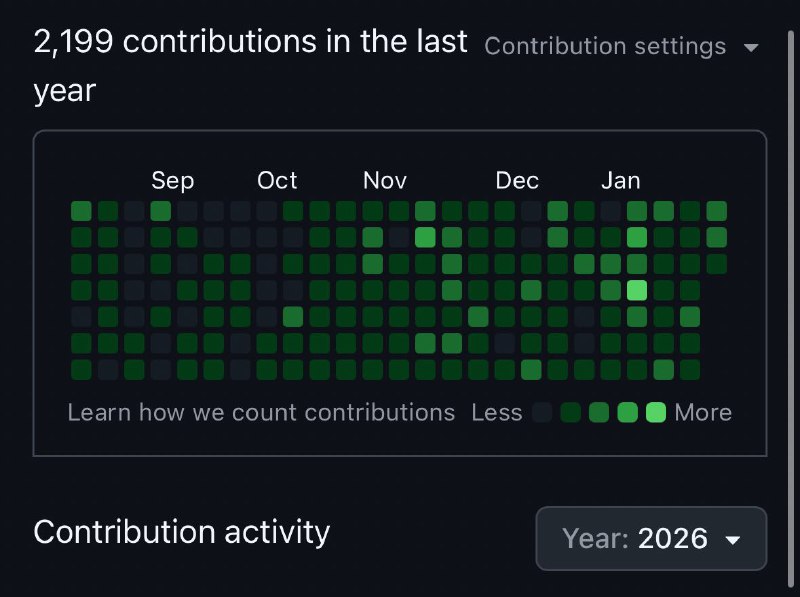

● Версия модели

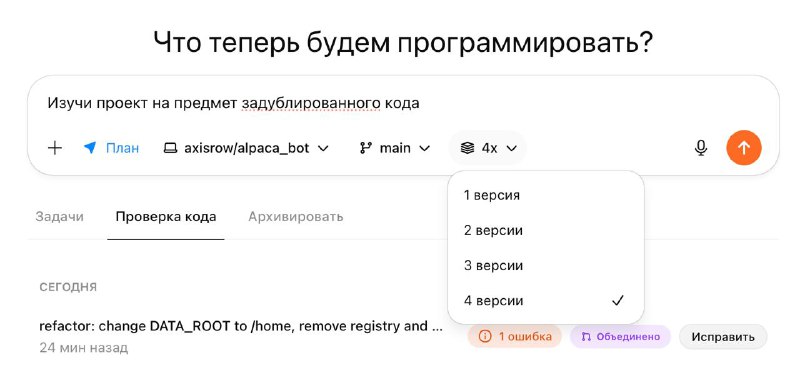

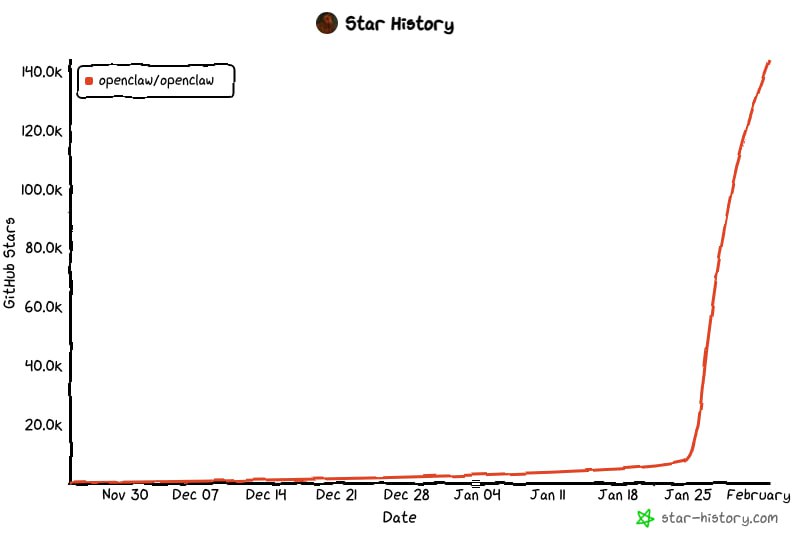

Видно, что мы обсуждаем актуальные релизы, а не то, что уже мхом поросло за прошедшие несколько месяцев

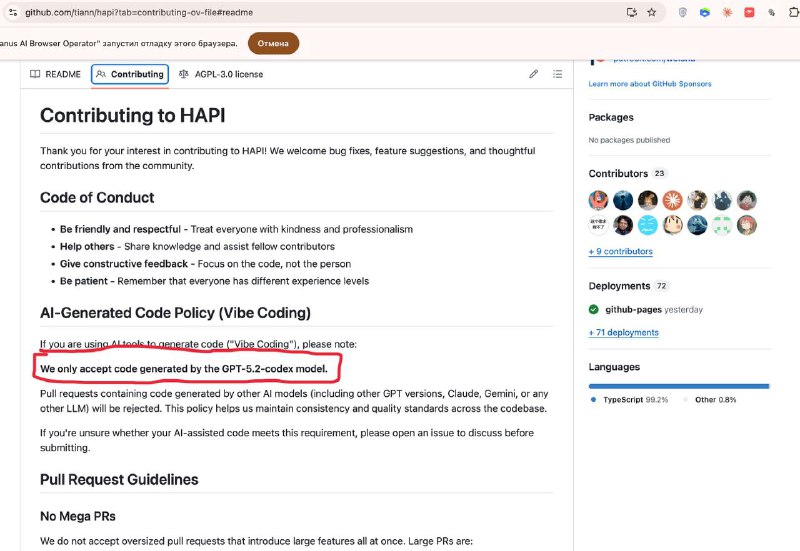

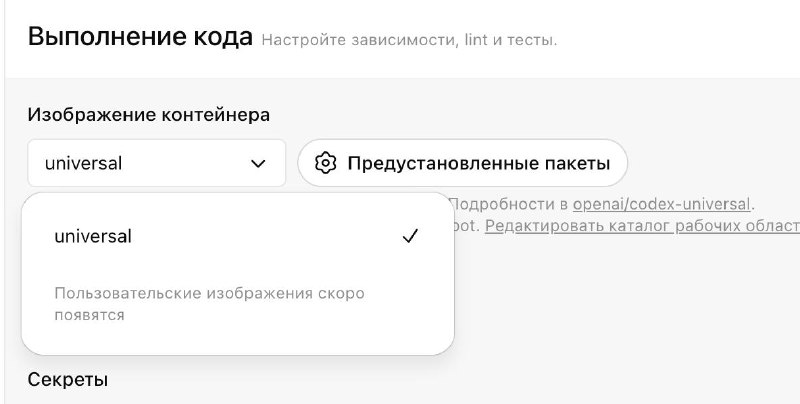

● Вариант модели

Конкретно у GPT 5+ есть тюн, Codex, который отличается от обычной GPT 5.2 по агентным возможностям и по работе с ризонингом

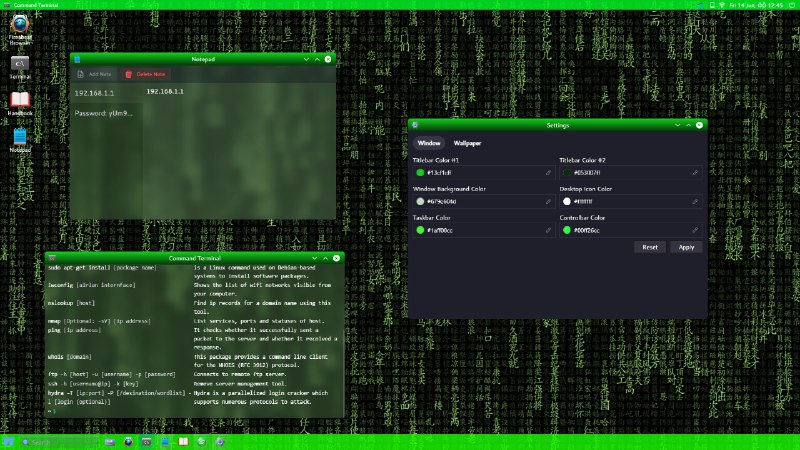

● Уровень ризонинга

Указан xhigh (ещё бывает low/medium/high). Доступен к изменению не у всех моделей, но кардинально влияет на продуманность выдаваемых решений

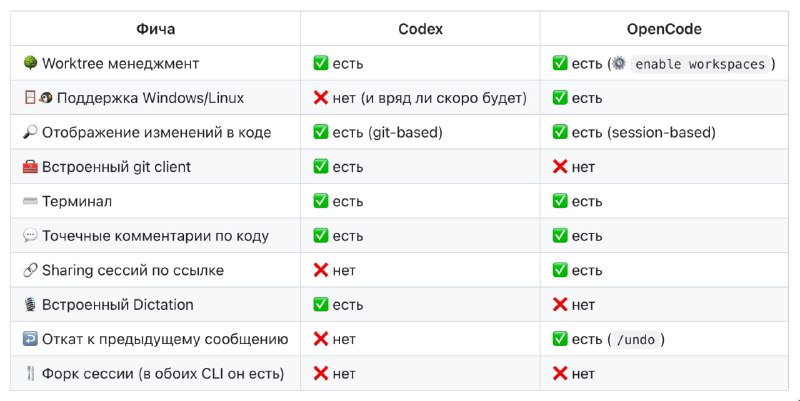

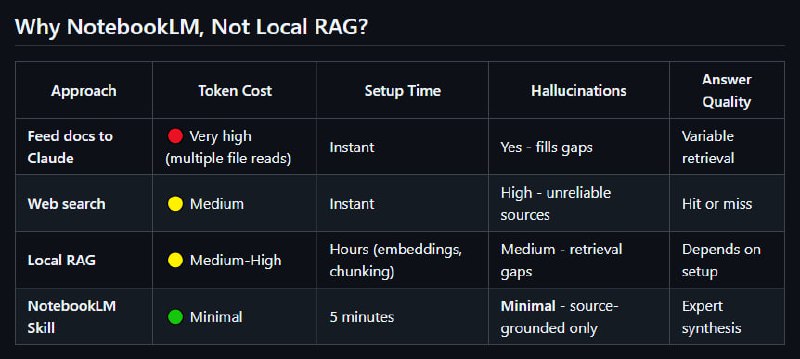

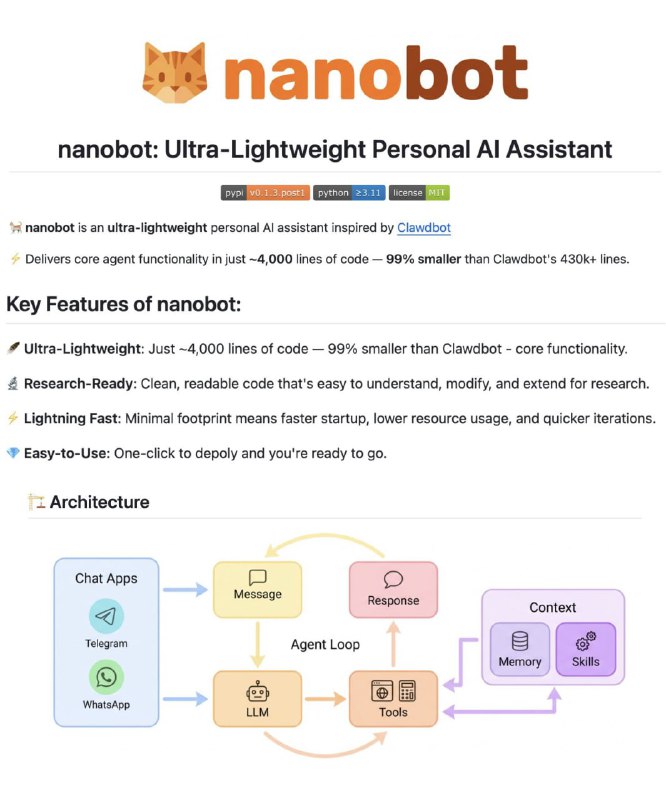

● Агент (обвязка)

Понятно, в составе каких агентов работают модели — это «родные», вендорские Claude Code & Codex CLI.

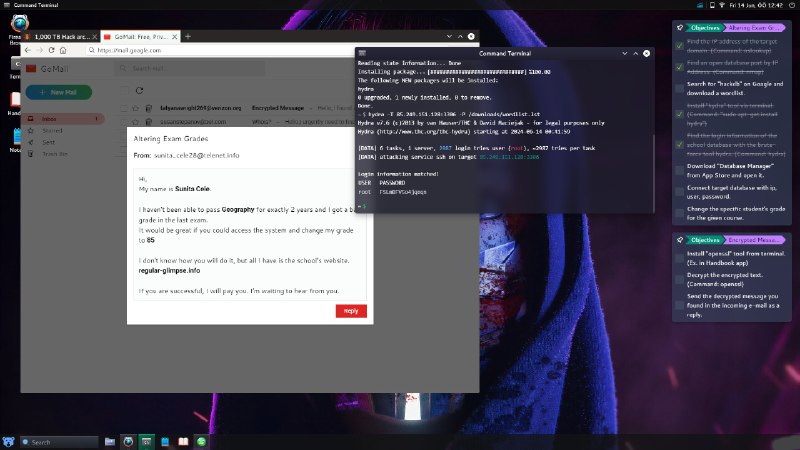

В разных агентах модель может вести себя совершенно по-разному, и те же GitHub Copilot & Cursor могут ощутимо отуплять модели

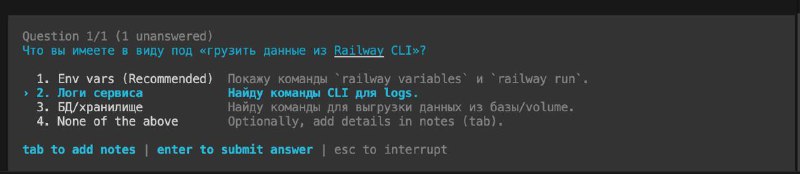

● Поставленная задача

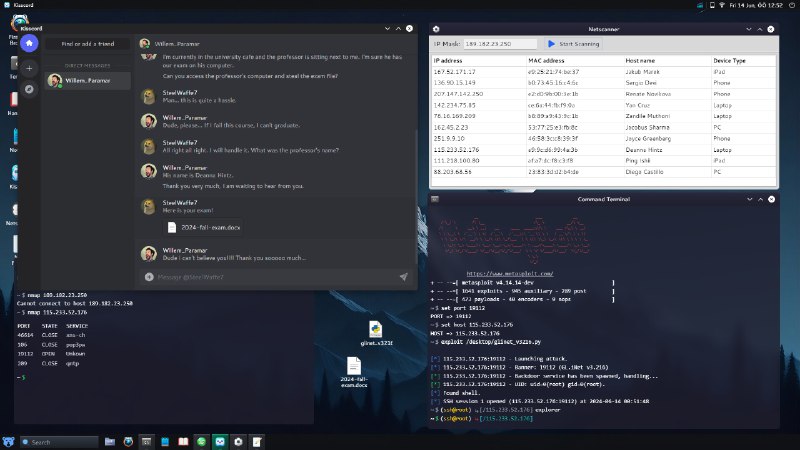

У текущих агентов и моделей сильно разные возможности и способности к решению разных проблем, и именно поэтому нередко приходится использовать несколько разных в одном проекте

● С чем ведётся сравнение и от какого опыта собеседника можно отталкиваться

—

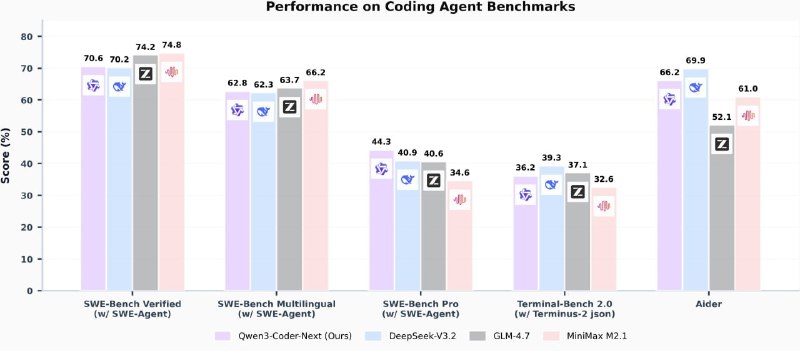

❗️Между разными связками модель + агент качество результата, производительность и уровень автономности могут отличаться на десятки процентов и казаться либо совершенно неприемлемым для работы, либо чудом.

Так что перечисленные характеристики — база для конструктивного и предметного обсуждения ИИ-агентов.

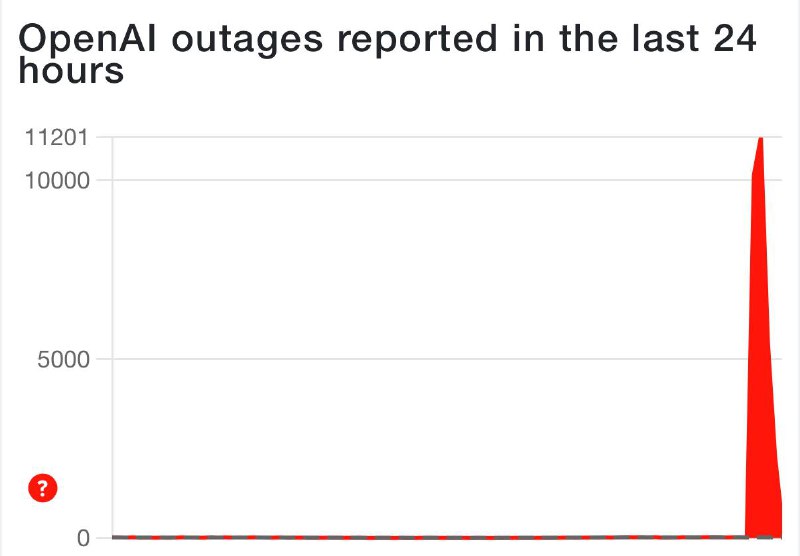

Я не говорю про версии самих агентов, повторяемость результатов, стабильность работы, промптинг, методологию, качество кодовой базы, сложность и гранулярность задач, локальные нейронки и т.п. — там куча своих нюансов 🙂

P.S.

● а GPT 5.2 (не-Codex) xhigh ещё лучше!

● нет, это не реклама, уже 5.1 лучше была — см. обзор, в чём конкретно

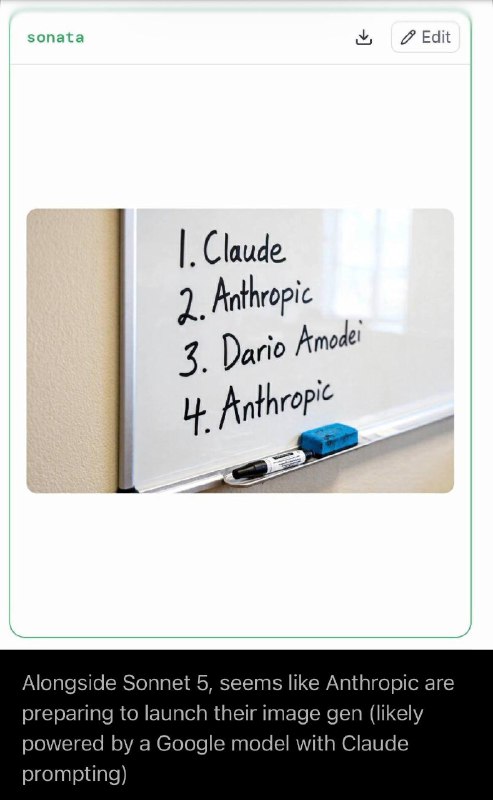

● но мы все ждём вскоре Sonnet 5 / Opus 4.6 / GPT 5.3 / Gemini 3 Pro GA, а там посмотрим 🙂